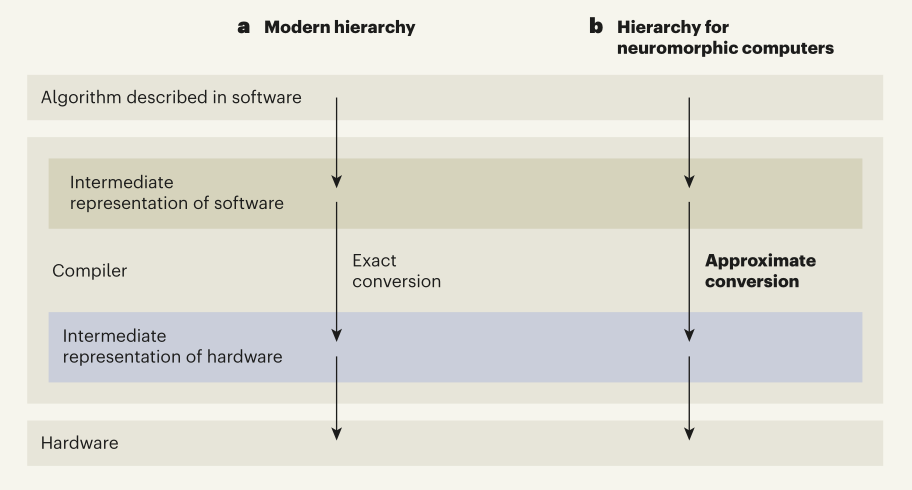

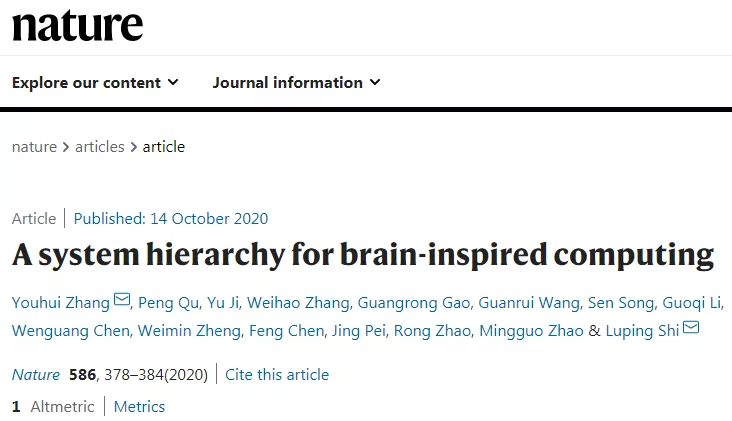

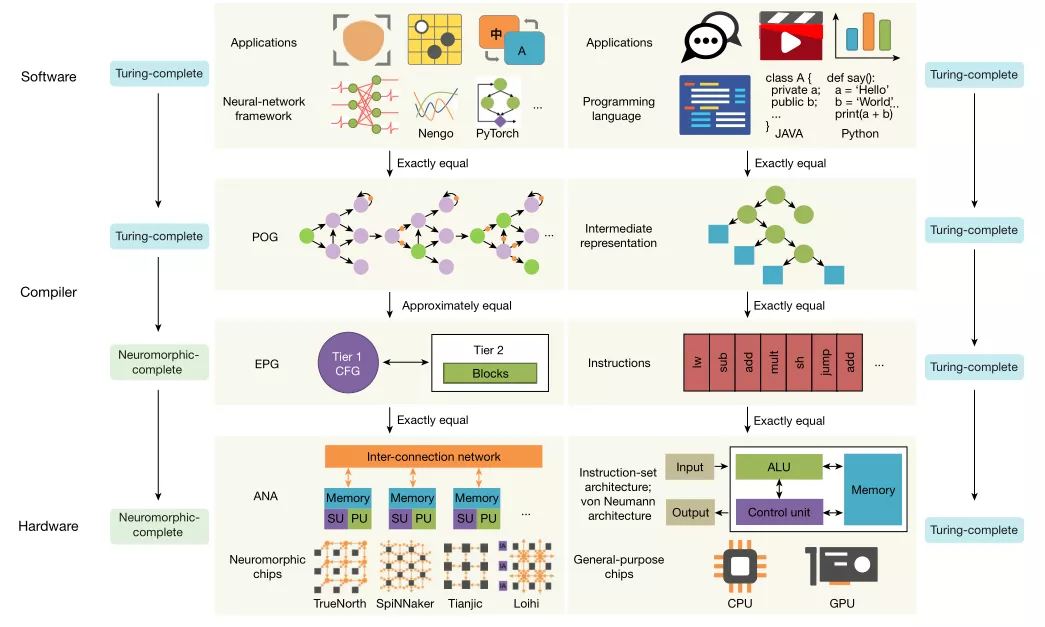

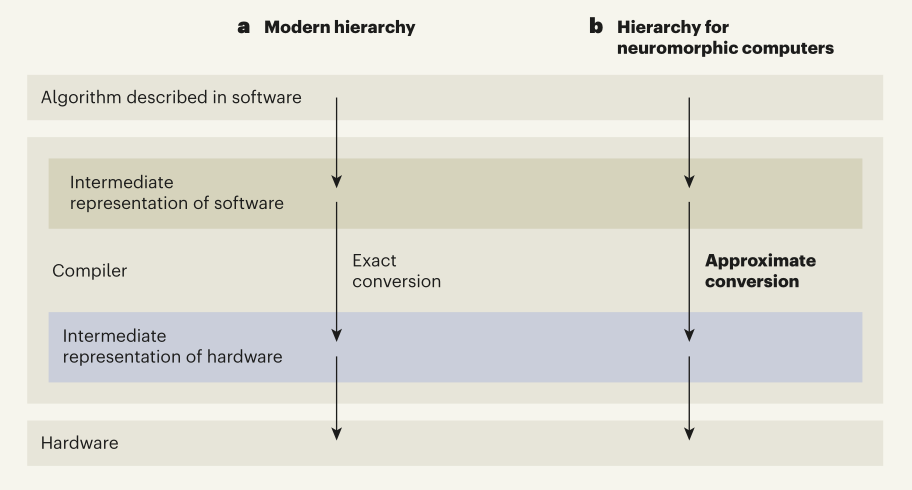

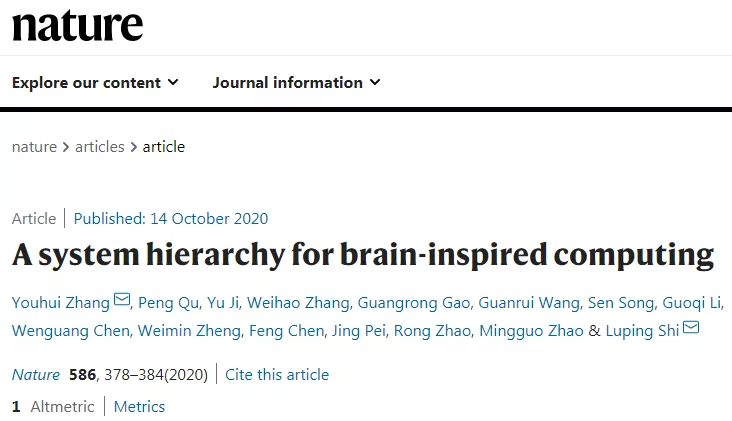

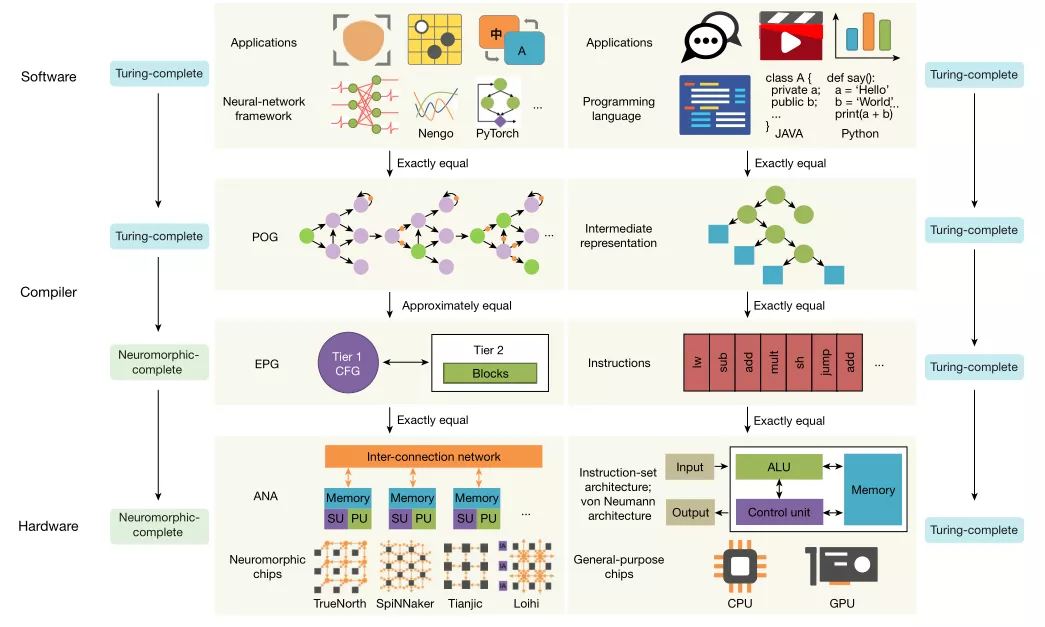

2020年10月14日,蘋果最新發布會上,iPhone12正式問世。采用5 nm制程的A14芯片,可集成11.8億個晶體管。6核CPU和4核GPU設計,神經引擎達到16核,每秒可進行11萬億次運算。1965年,英特爾創始人Gordon Moore首次提出摩爾定律,并于1975年進行修正。根據摩爾定律,技術進步將使集成電路(微芯片)的集成度大約每18-24個月翻一番。摩爾定律問世時,集成電路問世才6年,Moore實驗室在一個芯片上還只能集成50個晶體管。當時,摩爾定律像是天方夜譚;50年后的今天,最先進的芯片可以集成10幾億個晶體管。是的,在過去50年,傳統數字計算機的性能在不斷提高。集成電路的技術進步一方面使得硬件變得越來越強大,另一方面也給尋求優化算法性能的系統架構師帶來了挑戰。隨著設計者從通用的計算機技術轉向大腦啟發(神經形態)系統,他們也必須從支撐通用機器的既定形式層次結構中走出來。也就是說,抽象框架廣泛地定義了軟件是如何被數字計算機處理,并轉換成在機器硬件上運行的操作的,這種層次結構有助于實現計算機性能的快速增長。通用計算機設計的一個重要特點是軟硬件去耦合,而這一特點使得新設備(芯片、內存等)能夠獲得最佳性能。通過設置對硬件的最低要求,將用高級語言編寫的軟件程序,轉換成任何機器所需的精確等效的指令序列變得可行,這一過程稱為編譯。在這個編譯過程中,支持使用代表基本計算操作的指令的計算機被稱為圖靈完備。因此,軟件代碼通常只寫一次,然后可以在多個圖靈完備的處理器架構上編譯和執行,以產生等效的結果。然而,人們普遍認為,摩爾定律時代即將結束:數字計算機能力的進步速度似乎正在放緩。此外,數字計算非常耗能,促使人們尋找替代方案。傳統計算機依循馮·諾依曼架構設計,存儲與計算功能分離。每進行一次運算,計算機都要在內存和CPU兩個區域之間來回調用,大數據處理效率有待提高。除此之外,因為在存儲與計算空間之間來回調用,芯片的能耗大部分轉化為熱量,既不利于設備的性能穩定,又不環保。類腦芯片就不一樣了,人腦中存儲與計算功能是合二為一的。科學家們長期以來一直對大腦的計算能力著迷,大腦不僅具有難以置信的能效,而且由于其神經元和突觸的架構,還擁有獨特的信息處理性能。類腦芯片可以模擬人腦的復雜處理能力,啟發了神經形態計算領域,一個使用大腦神經網絡結構作為下一代計算機基礎的研究領域。神經形態計算的重點通常是脈沖神經網絡——由相互連接的人工神經元組成的系統,其中每個神經元在激活水平達到閾值時都會表現出短暫的“脈沖”。與現代深度學習應用中常用的人工神經網絡相比,這種系統更類似于生物神經網絡。神經形態硬件已經產生了一系列的格式,包括數字和模擬。然而,大多數系統都有共同的設計原則,例如內存和處理器的協同定位。開發神經形態硬件應用一個挑戰是,目前不存在圖靈完備性等形式層次。相反,每個新的芯片架構都需要一個定制的軟件工具鏈,即一組編程工具來定義算法,并通過將它們映射到獨特的硬件上來執行它們,這使得很難比較執行相同算法的不同神經形態系統的性能,并且需要研究人員理解算法和硬件的所有方面,以獲得潛在的類似大腦的性能。清華大學施路平團隊長期致力于類腦計算領域的研究。2015年,第一代“天機芯”DEMO問世,制程約為110納米。2017年,第二代“天機芯”芯片制程為28 nm。2019年7月31日,施路平團隊以Towards Artificial General Intelligence with Hybrid Tianjic Chip Architecture為題,在Nature封面論文報道了第三代天機芯片,通過無人駕駛自行車上的實驗演示,實現了機器學習和類腦算法的完美結合,標志著中國在人工智能領域進入了關鍵時刻。時隔一年之后,2020年10月15日,清華大學施路平、張悠慧等人又一次在Nature發表類腦計算的最新研究成果。他們定義了一個新的層次結構,將算法的要求及其在一系列神經形態系統上的實現形式化,從而為結構化的研究方法奠定基礎。在該方法中,受大腦啟發的計算機的算法和硬件可以分別設計。值得一提的是,在這兩個重大研究成果中,施路平教授都是通訊作者,而張悠慧教授都是第一作者之一,并在最新的Nature論文中擔任通訊作者之一。這一次,清華大學施路平、張悠慧研究團隊提出了一個突破性解決方案,他們稱之為神經形態完備性。這是對圖靈完備性的認可,旨在將算法和硬件開發分離開來。作者提出,如果一個類大腦系統能夠以規定的精確度執行一組給定的基本操作,它就是神經形態完備的,這是對圖靈完備性的一種偏離。在圖靈完備性中,一個系統只有在為給定的一組基本運算提供了精確且同等的結果時,才能被定義為完備的。在提出的神經形態完備框架中,基本操作包括兩種,稱為加權和操作和元素校正線性操作,這使得硬件系統能夠支持脈沖和非脈沖人工神經網絡。作者展示了他們的大腦啟發計算的層次結構如何提供一種機制,將給定的算法轉換成適合一系列神經形態完整設備的形式。新層次結構的一個關鍵亮點在于,提出了一個連續完備性——可以接受不同級別的算法性能,這取決于神經形態系統執行基本操作的準確性。這種完備性的連續性意味著,新的層次結構可以使用所有可用的模擬和數字神經形態系統來實現,包括那些為了執行速度或能量效率而犧牲準確性的系統。圖2 類腦計算機層次結構(左)與現有通用計算機(右)的對比完備性的連續還允許算法的在同一硬件上的不同運行。例如,探索如何根據芯片大小來權衡算法精度,以降低功耗。研究人員在三個任務的算法執行中展示了這一方面(“駕駛”無人駕駛自行車、模擬鳥群的運動以及執行稱為QR分解的線性代數分析)。每個任務使用三個典型的神經形態完備硬件平臺來執行:作者自己的神經形態芯片,通用計算機中使用的圖形處理單元,一個基于憶阻器設備的平臺,可以加速神經網絡的運行。1)能夠比較實現相同算法的等效版本的不同硬件平臺,以及在相同硬件上實現的不同算法。這兩個都是對神經形態架構進行有效基準測試的關鍵任務。將通用的圖靈完備硬件(GPU)包含在他們的驗證實驗中也是非常有價值的,因為這表明在某些應用中,層次結構可以潛在地用于證明神經形態設備優于主流系統。2)有可能將算法和硬件開發分開。如果要獲得底層神經形態架構的益處,算法規模和復雜性將需要隨著時間的推移而增加。因此,這種分離將有助于研究人員專注于研究問題的特定方面,而不是試圖找到完整的端到端解決方案。這可能會導致對問題的更好理解,并為未來更高性能的神經形態系統的設計提供信息。清華大學研究團隊提出的這種層次結構,為統一許多工業和學術研究小組在神經形態計算領域開展的工作,做出了重要推動作用。真正的大腦——生物“硬件”本身是否具有完整的神經形態還有待觀察,但所提出的方法讓我們更接近類腦計算。[1] Youhui Zhang, et al. A system hierarchy for brain-inspired computing, Nature, 2020,586: 378–384DOI: 10.1038/s41586-020-2782-yhttps://www.nature.com/articles/s41586-020-2782-y[2] Oliver Rhodes. Brain-inspired computing becomes complete, Nature, 2020, 586: 378–384.DOI: 10.1038/d41586-020-02829-whttps://www.nature.com/articles/d41586-020-02829-w